# 《AI Agent 脚手架 + 场景应用》- 综合 Spring AI、LangChain4j + Google ADK(a2a、mcp、skills),打造全新智能体架构方案。

作者:小傅哥

博客:https://bugstack.cn (opens new window)

项目:https://t.zsxq.com/a8AJj (opens new window)

沉淀、分享、成长,让自己和他人都能有所收获!😄

大家好,我是技术UP主小傅哥。

💥炸了!日更,日更,接下来这套新项目,即刻开启日更! 是的,小傅哥又一个新 AI 项目来啦。可以说,现阶段 AI 是每个工程师都必备的技术技能。

从 RAG 到 MCP、A2A 再到 Skills,一系列的 AI 编程技术技能陆续迭代更新,

各个互联网企业也随之跟进开发自身的 AI Agent 智能体,解决业务场景问题。

因此你在 Boss 直聘,校招/社招,都能看到大量的 AI 应用开发岗位。AI 没让程序员工作丢失,反而多了更多的岗位!

新项目,📅于25年12月初启动,26年2月底完结,将近耗时90天打造精品企业级智能体解决方案项目。

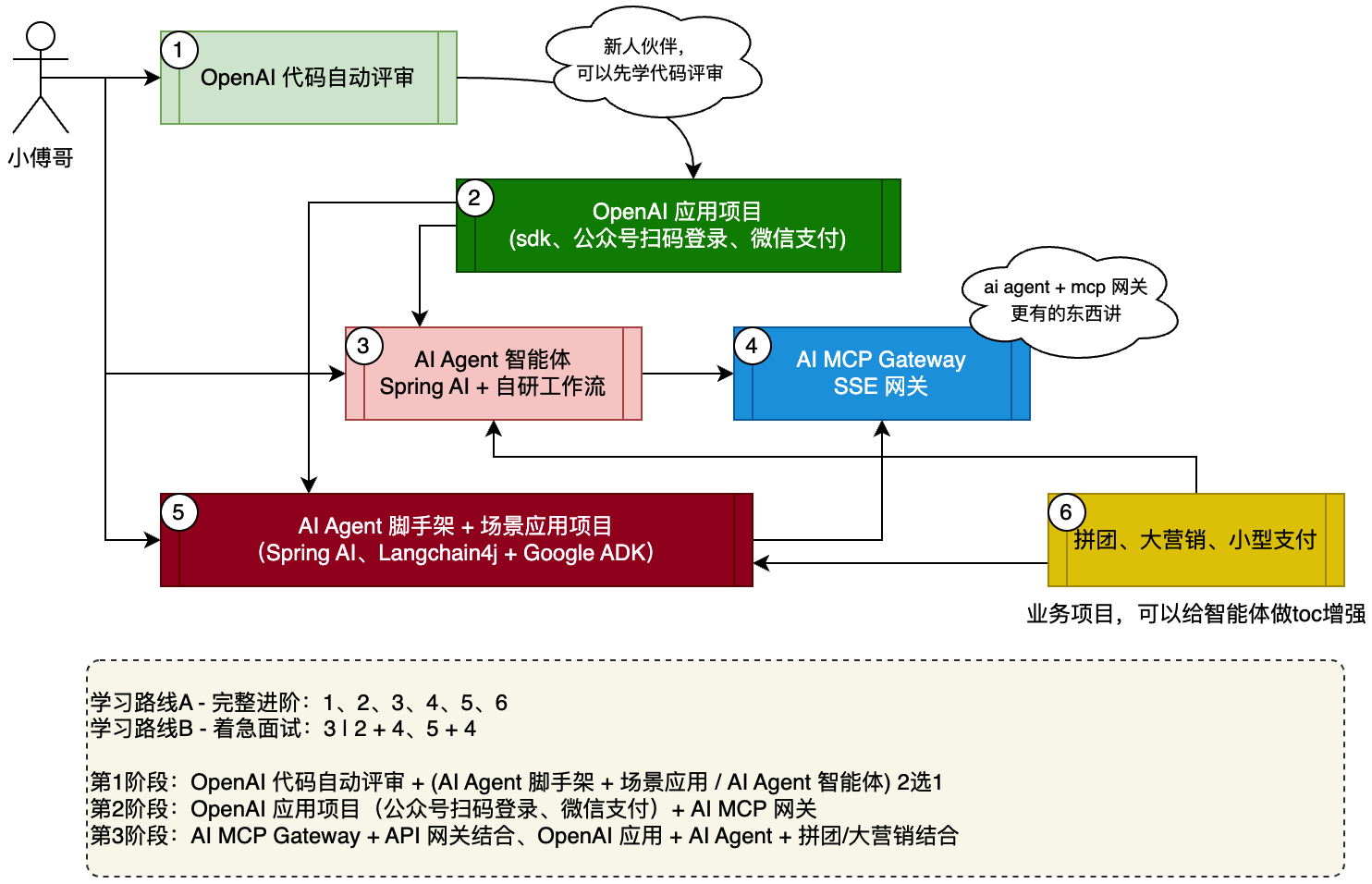

在小傅哥社群,OpenAI 代码自动评审做了、OpenAI 应用 + 扫码登录 + 微信支付 + 敏感词过滤 + SDK 开发做了、AI Agent 可视化编排也做了、AI MCP 网关深入理解 MCP 协议还做了!

那为什么还要做一个 AI Agent 呢?🤔🤔🤔

因为 【AI Agent 可视化编排】 解决的是横向通用性场景方案,而本次要做的 【AI Agent 脚手架 + 场景方案】 是纵深业务场景细化方案(也是企业里必备的架构设计,针对细化场景,通用的编排就失效啦!)。这些东西,不是个架构师带着你,那你就根本理解不到!

好,该项目为大家带来一套企业级 AI Agent 智能体脚手架底座及场景应用方案的实战编程项目。项目采用 Spring AI、Langchain4j(对照学习) + Google ADK(a2a 框架 + 工作流编排),融合 MCP、Skills、Plugin、Session 等多项智能体开发技术,构建通用智能体脚手架工程。

并借助该脚手架,用户能够快速高效地搭建各类智能体应用场景。就像本次项目,既带着你搭建脚手架,也带着你使用脚手架做场景用(价值超级大,还要带着你做手机版大龙虾 MobileOpenClaw 🦞!)。

💻 每个工程师,都需要AI应用编程技能!

竹外桃花三两枝,春江水暖鸭先知🦆。没有哪个行业,有程序员👨🏻💻可以这么快的接触到世界的科技变化。甚至也只有程序员行业,可以驾驭 AI 技术,做出各项 AI 应用软件。AutoPhone、OpenClaw,码农正在加速改变这个世界!

当前互联网企业,Java 有庞大的市场,如美团、京东、阿里、饿了么、滴滴等。这些业务都要大量的引入 AI 进行提效,如;客服、巡检、运营、监控等。因为这些业务本身也都是基于 Java 构建,背靠 Spring 框架。所以很多公司也就天然的选择了 Spring AI 框架开发智能体应用。包括;阿里还基于 Spring AI 做了 alibaba 版本,谷歌也做了 google adk 框架。现在你懂了,为什么我们选择 Spring AI 实现业务智能体项目了吧!当然,这些框架也都类似,选择一套学习后,其他的也都很容易上手。

🧧 文末提供了本套项目的完整工程代码,此外还有其他的业务项目 + 组件项目,共计20个全部可以获取。

# 一、我能学到什么

首先,这是一整套从0到1,文档 + 视频 + 源码,包含前后端 + DevOps 的综合实战项目。带着大家进行需求分析、底座构建、脚手架设计、应用场景实践。所以,你可以非常完整的学习到关于 AI Agent 智能体的全部内容,让你具备企业级项目开发能力。

- 【后端】熟练 Spring AI、Langchain4j(对照学习)框架的使用知识,掌握 api、model、client 的组装构建。

- 【后端】深入 Spring AI 框架,使用 spring-ai-community 包,引入 Agent Skills 技能。

- 【后端】设计多种 MCP 加载策略,满足 local、sse、stdio 各种类型的加载操作。

- 【后端】运用 Google ADK 框架,整合 Spring AI、Langchain4j 分别验证学习,做好技术调研。

- 【后端】使用 Google ADK 框架,通过提供的 loop(循环)、parallel(并行)、sequential(串行),构建多样性智能体。

- 【后端】通过 Google ADK 框架,掌握 Runner 运行插件机制,掌握智能体运行中各个节点的数据采集和控制操作。

- 【后端】设计通用智能体配置 yml 文件,通过配置文件的内容编排,可以配置出复杂的智能体。

- 【后端】深入 Google ADK 源码,调试源码找到bug,并提供解决方案。已经在google adk 发布了issue #705 - 小傅哥为 Google ADK 框架,提交的 issue 记录 (opens new window)

- 【后端】拓展设计模式的使用,在智能体构建中,使用规则树模式进行各个节点的编排。编排依赖于 agent.yml 文件的配置。这是非常灵活的设计。

- 【后端】基于 Maven 脚手架构建方式,对底座工程创建出通用脚手架项目。

- 【后端】积累 Netty 通信技术,基于 Netty 构建通信网关。

- 【前端】安卓 Android(Kotlin) 网关终端开发,做智能设备控制。

基于 AutoPhone 9B + OpenClaw 理解,构建 MobileOpenClaw - 【前端】使用 React 构建前端工程 + draw.io,实现出一套智能体绘图操作。这部分会结合 AI IDE + prompt 进行编程实现。

- 【运维】在云服务器环境(Ubuntu 24)安装 Docker 环境 + Protainer 管理面板,以及初始化环境等(提供了一件安装脚本)。

- 【运维】分别对前后端进行 docker 镜像构建,以及在云服务器上完成项目的部署操作。

- 【其他】积累应用设计经验,面向对象开发,在整个工程实现中,都有非常干净,清晰,具备高内聚,低耦合,有单一职责的逻辑体现。

小傅哥带着你做的是企业级项目架构和技术积累,通过这些东西的学习,在面试中与面试官交流,才会显得更为专业。

# 二、适合哪些伙伴

- 需要快速🔜写到简历(每个阶段完成都可以写简历),用于秋招/社招面试(本项目可快速部署验证结果)。

- 对 AI Agent 智能体感兴趣,但不知道如何自己实现一套的。

- 希望提高自己的架构设计思维,设计模式运用的。

- 增强核心竞争力,储备一些非业务的核心技术类知识的。

- 需要掌握 Spring AI、Langchain4j、Google ADK 框架使用。

# 三、项目是否硬核

很多小伙伴都害怕学习到一个(前端)外壳漂亮,(后端)代码水货的项目,满是 CRUD 缺少架构设计,也没有编程思维的体现。这样的项目,在面试后端工程师的时候,很难讲出东西。所以,这里小傅哥先把一些核心的架构设计给大家看看,让大家知道小傅哥带着你学习的东西质量如何。

# 1. 智能体整体设计

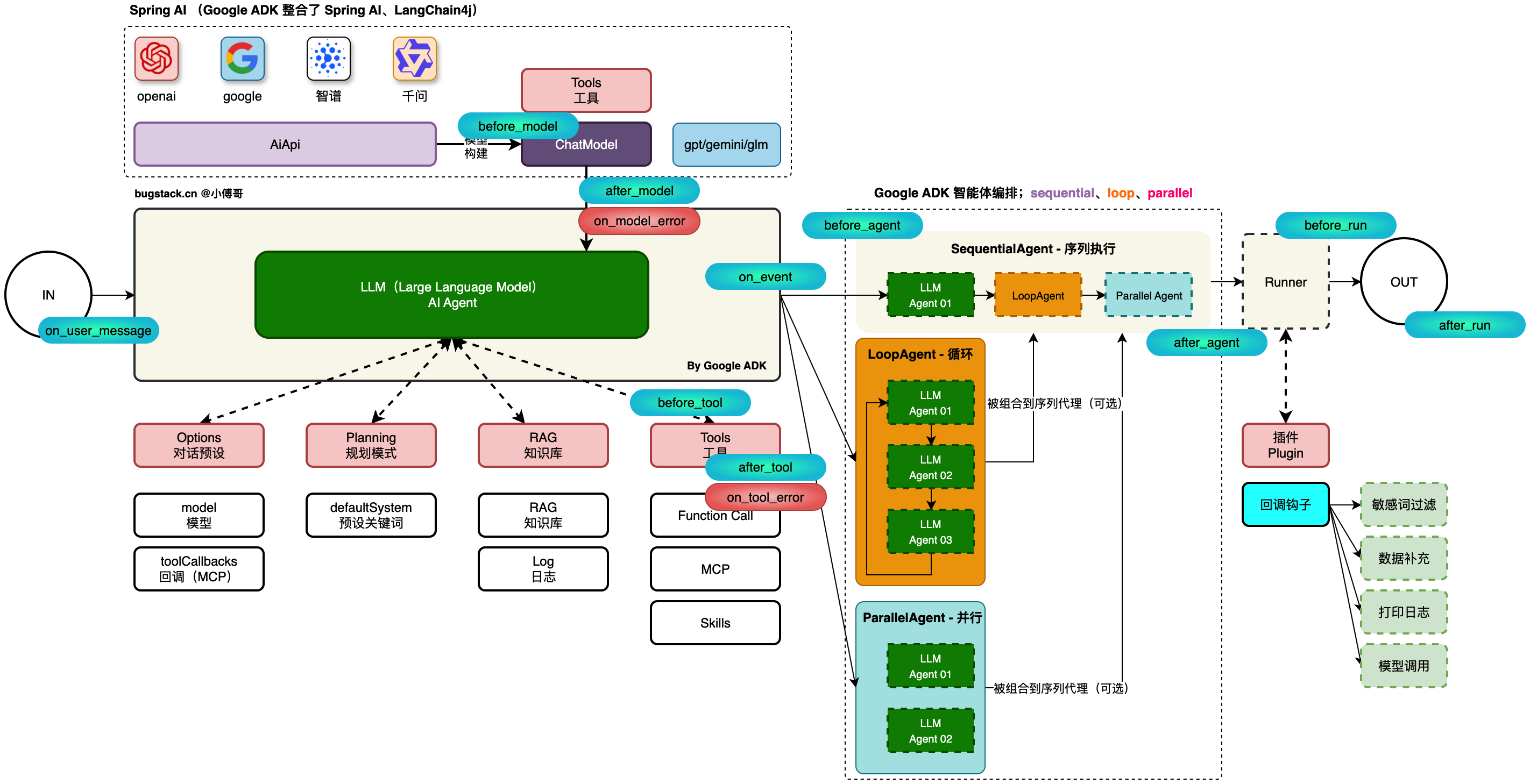

- 2025年11月27日,Google 正式在 Maven 仓库管理中心,推送了 0.4.0 版本 ADK,该版本新增加了 Spring AI 的集成。google-adk-spring-ai (opens new window) 至此,也因此,小傅哥决定基于这套服务组合,设计智能体脚手架。

- 首先,Google ADK 是一个智能体框架,他自身也是支持直接对接各类大模型的 API,以及构建 ChatModel 的。但在整合 Spring AI、LangeChain4J 以后,Google ADK 的使用,将会得到已经使用上述组件的公司更大的青睐。

- 之后,Spring AI 解决的 AI 对接的前半部分,让你可以把 AI API、Model、Prompt、RAG、Tool(Function、MCP)等,非常方便的构建出一个单一的 AI Agent 服务(也可以称之为是一个客户端)。

- 然后,Google ADK 解决的是,多个 AI Agent 怎么协同工作的问题。这里包括,Sequential 序列顺序执行、Loop 循环执行、Parallel 并行执行,而这些执行方式,又可以组合搭配的配置到一个 Sequential 中进行顺序执行(注意图中颜色)。绿色的是大模型服务,绿色部分可以被深黄色或者浅青色包装,之后在组合到 SequentialAgent - 序列执行中。

- 最后,Google ADK 提供了记忆上下文 Runner 执行器(也可以自己扩展实现),在这里又提供了钩子插件,你可以对执行过程中的流程,进行拦截。这个过程类似 Spring 容器中对 Bean 对象的处理,before、after 的过程。

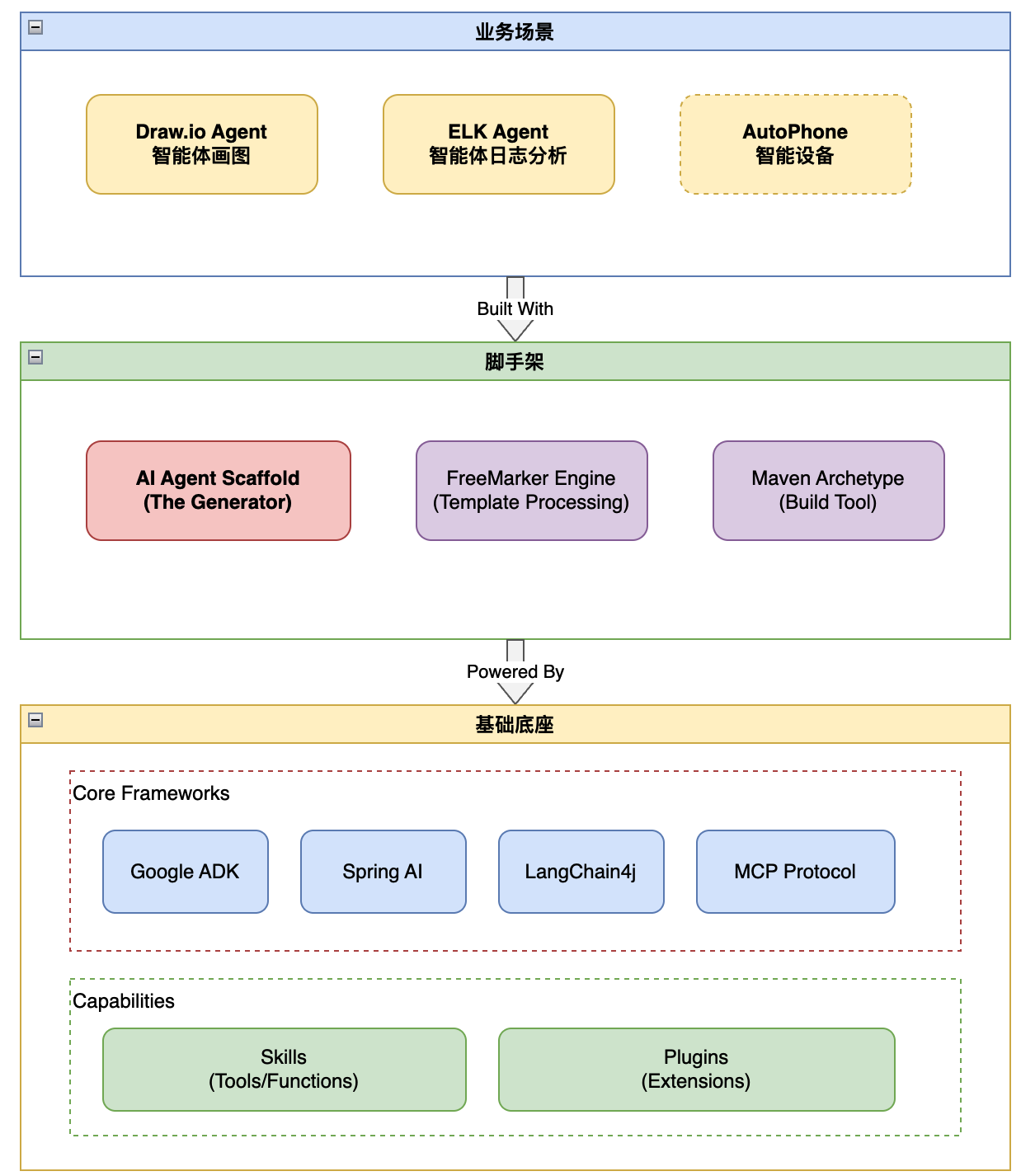

# 2. 系统的分层结构

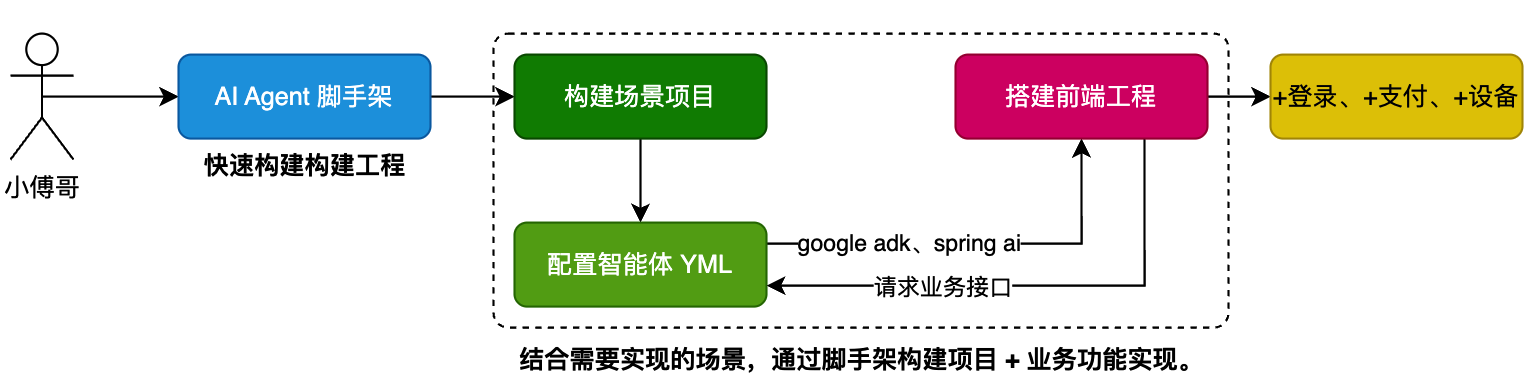

如图,整体简要架构设计(剥离其他流程,方便理解);

整个应用架构分为3层,包括;基础底座、脚手架、业务场景;

- 基础底座,负责整 Spring AI + Google ADK 框架的使用,这里的重点在于整个智能体工作流程的设计和使用(第2部分20节课程)。

- 脚手架,将基础底座使用 maven 抽取出脚手架,脚手架可以让我们快速复刻出一套基础工程(第3部分3节)。

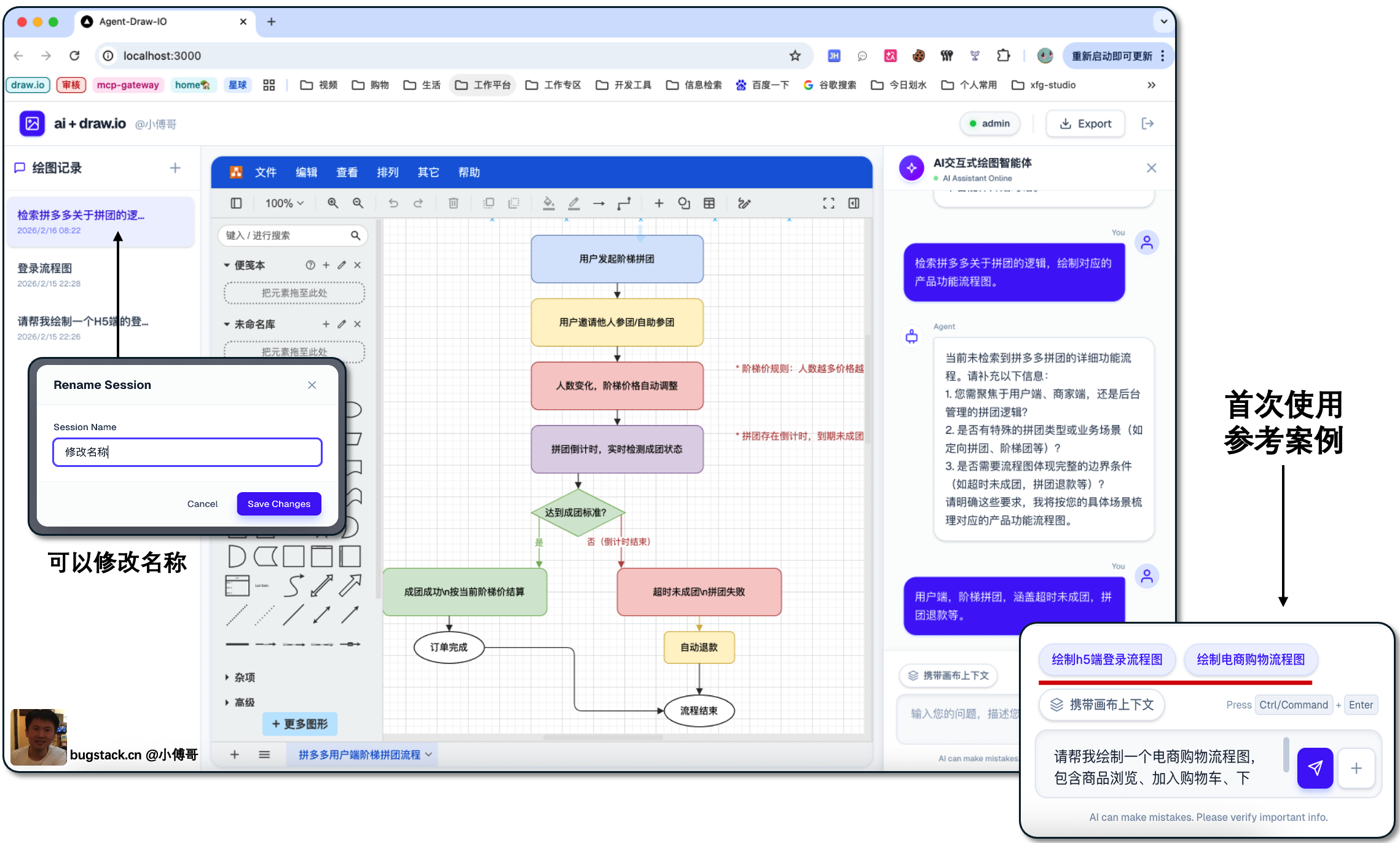

- 业务场景,结合 draw.io 绘图操作 + ai agent 智能体,做一套AI交互式画图系统(第4部分6节)。

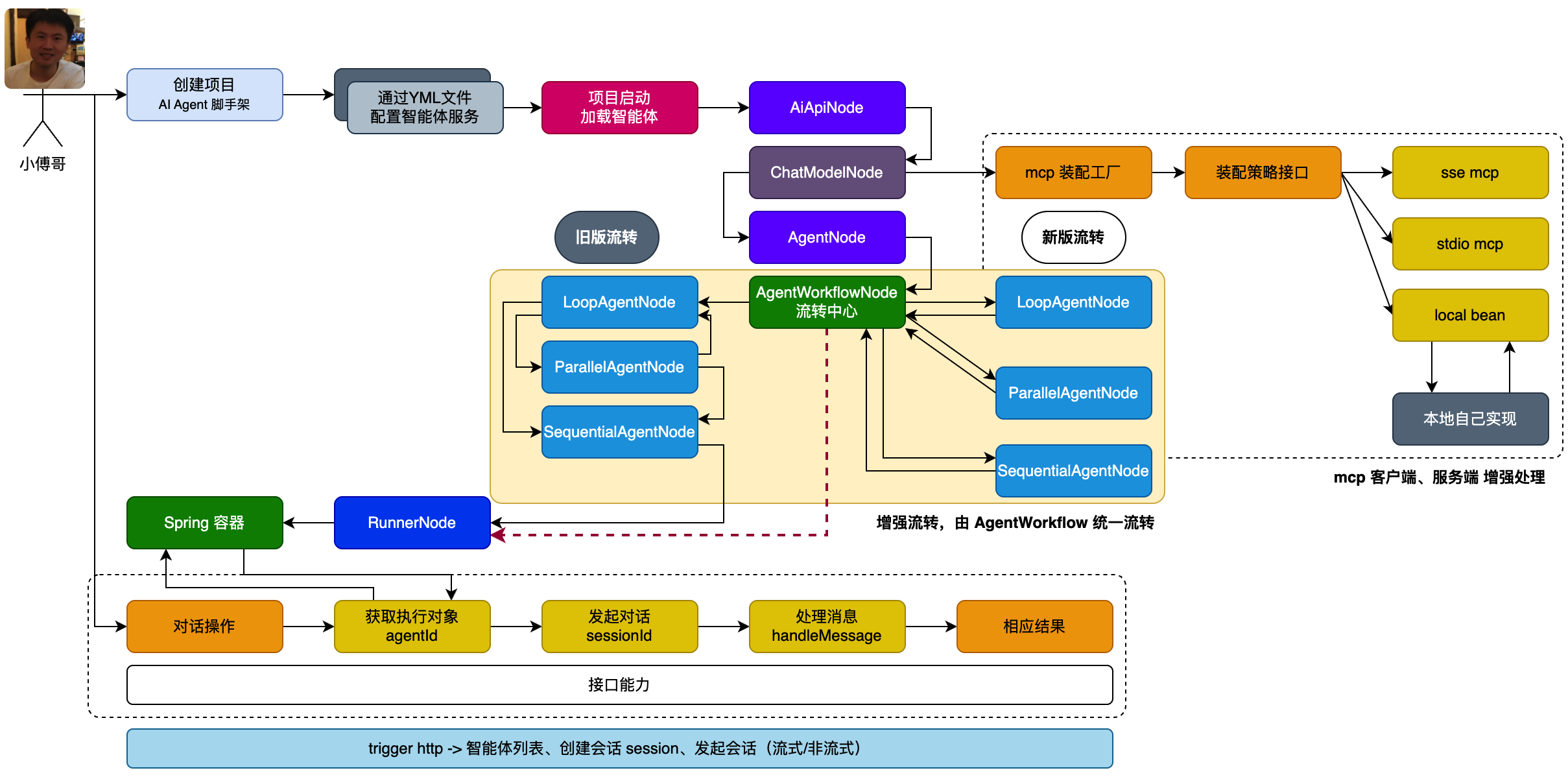

# 3. 底座的运行流程

- 首先,从用户基于脚手架创建完成后,在使用 YML 文件进行智能体的配置,之后在启动项目后,会进行一些利的装配。api、model、agent、workflow、runner,再到 spring 容器。

- 其中,关于智能体的工作流组装是非常巧妙的,可以自由组合出多种类型智能体。这部分不需要硬编码即可完成。

- 最后,是整个内容装配完成后,提供了通用的接口能力可以进行对话。

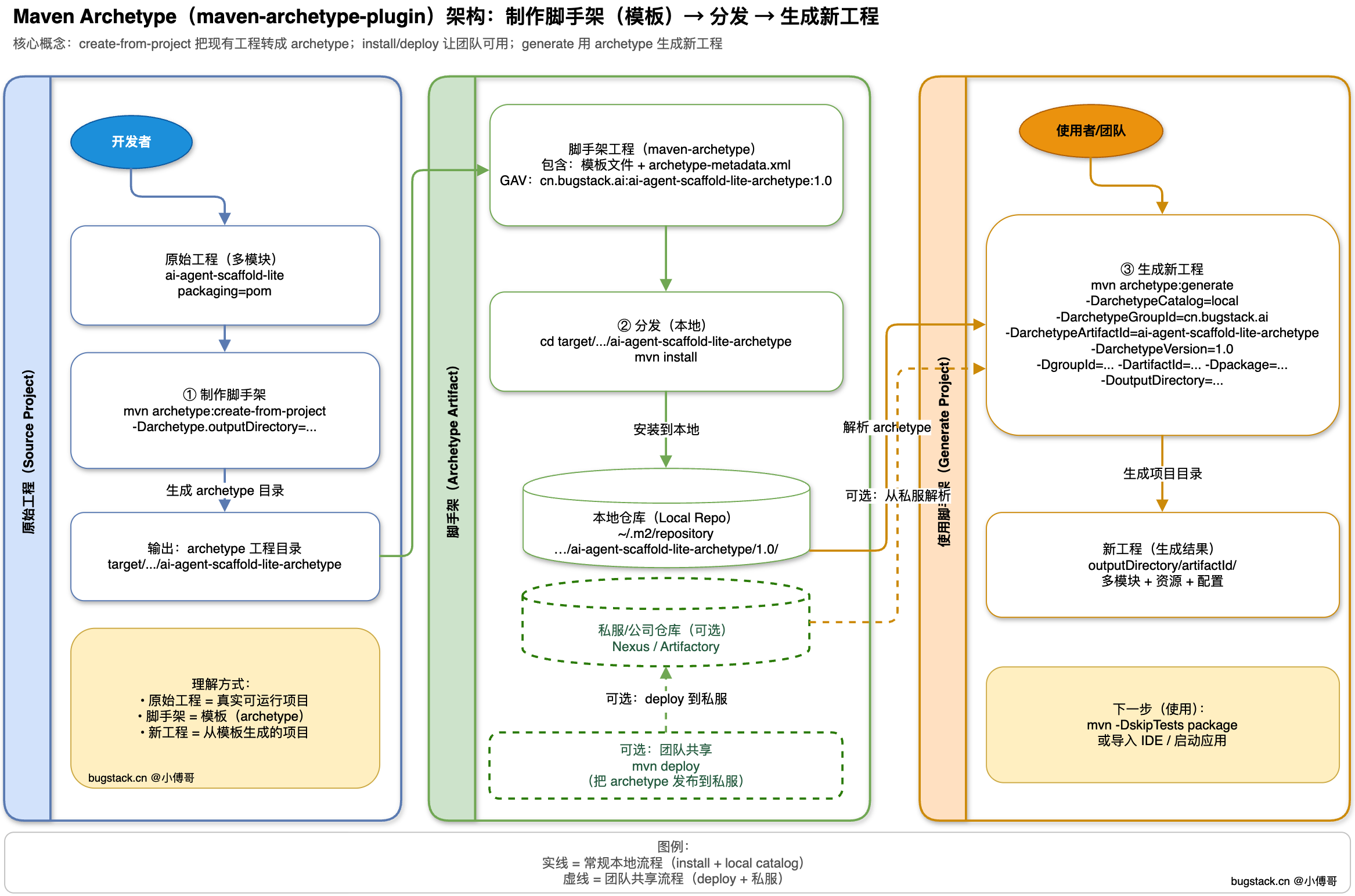

# 4. 脚手架配置发布

- 左侧,对现有工程使用 maven-archetype-plugin 插件,构建工程脚手架。将当前的工程打包成一个可复用的 Archetype 模板。

- 中间,打包好的脚手架,可以在本地直接使用,也可以发布jar到私服,让大家都可以使用。私服部分,后续在做处理。

- 右侧,使用方可以基于命令,或者 IntelliJ IDEA 配置 Maven 脚手架的方式,创建和启动工程。这一节,我们先通过命令的方式使用。

# 四、应用场景举例

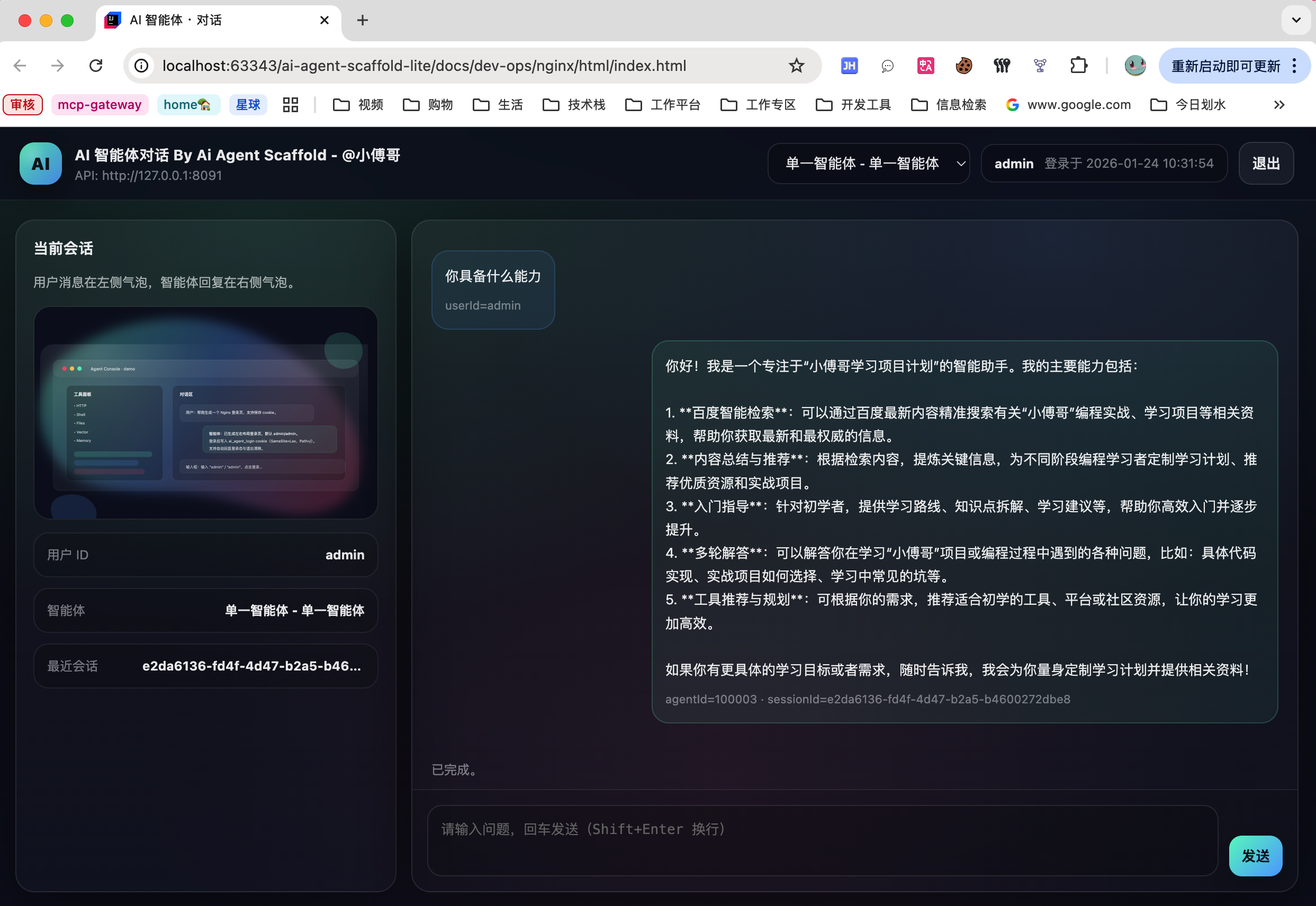

# 1. 普通对话

- 智能体搭建后,可以进行对话操作,基于你配置的 MCP 能力,它可以做很多事项。

# 2. draw.io + 画图

agents:

# 1. 需求分析与检索智能体

- name: agent_analyst

description: 负责理解用户意图,调用工具检索信息,并决定是请求补充信息还是继续绘图。

instruction: |

你是一个专业的需求分析师。你的任务是分析用户的绘图请求。

1. 如果用户提供了具体的上下文或需要引用外部知识(如Git仓库、本地文件),请使用可用的工具(MCP)进行检索和分析。

2. 分析用户的意图:

- 如果用户的描述模糊、不完整,无法直接生成图表,你需要返回 JSON 格式要求用户补充信息。

格式:{"type": "user", "content": "请补充关于...的具体信息"}

- 如果用户意图清晰,请整理出详细的绘图需求(图表类型、节点、关系、布局要求等)。

3. 输出你的分析结果。

output-key: analysis_result

# 2. 绘图执行智能体

- name: agent_drawer

description: 根据分析结果生成 Draw.io 的 XML 数据。

instruction: |

你是一个 Draw.io 绘图专家。请根据输入 {analysis_result} 进行操作:

1. 如果输入是 {"type": "user", ...},请直接原样输出该 JSON。

2. 如果输入是详细的绘图需求:

- 设计图表的结构(UML、流程图、时序图等)。

- 生成符合 Draw.io 规范的 XML 代码。

- 确保节点布局合理,逻辑清晰,连线不能交叉等。

- 输出生成的 XML 内容。

output-key: draft_diagram

# 3. 检查与优化智能体

- name: agent_reviewer

description: 检查绘图结果,确保无连线交叉等问题,并格式化最终输出。

instruction: |

你是一个图表质量检查员。请审查输入 {draft_diagram}:

1. 如果输入是 {"type": "user", ...},请直接原样输出。

2. 如果输入是 XML 代码:

- 检查连线是否混乱或有严重的交叉(在文本层面尽力优化布局逻辑)。

- 检查 XML 语法是否正确。

- 如果有问题,请尝试修正 XML。

- 最终输出必须严格符合 JSON 格式:

{"type": "drawio", "content": "这里放最终的XML字符串"}

output-key: final_result

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

- ai agent + draw.io,可以配置出一套交互式绘图智能体。我们可以把诉求发给 AI,之后 AI 进行分析和决策,让用户补充信息或者直接画图。

- 在大量的测试和体验中,这套智能体 + gpt 5.1 可以绘制出非常符合企业中真实场景的流程图,效果还是非常不错的。如果你还配置 mcp 可以结合本地代码库,文档库,产品PRD库,那么它还可以更好的绘制出相关的流程图。

# 3. AutoPhone 实验性场景

智谱发布过一个 Open-AutoGLM (opens new window) 类似于豆包手机,可以通过指令发送 AI,AI 操作手机完成一系列动作。目前官网这套产品目前使用的是 ADB 连接手机,数据线调试方式。

- 文档(手机 + Agent):https://bugstack.cn/md/algorithm/model/autoglm-phone-agent.html (opens new window)

- 官网:https://github.com/zai-org/Open-AutoGLM (opens new window)

这里小傅哥在体验了 OpenClaw 大龙虾的设计后,对 AutoPhone 也有了想法。我们可以设计一套安卓版的手机 MobileOpenClaw,在手机端开发一个网关,网关功能具备;启动应用、点击指定坐标、输入文本、滑动屏幕等。之后在让 AI 以借助 Socket 通信,对手机设备进行管理。

- 首先,需要实现一套 MobileOpenClaw 的网关,这部分内容是安卓开发的一个软件,如果 IOS 也还有其他方案。可以在 Github 检索相关资料 https://github.com/search?q=phone%20agent&type=repositories (opens new window)

- 之后,基于脚手架,开发 MobileOpenClaw 智能体,这部分要通过 Socket 和 手机端进行通信。让 AI 识别用户意图,控制手机端执行相关操作。因为这里大量的视觉识别,所以 gemini-3-pro-preview 效果不错,另外就是 GLM 定制的 AutoGLM-Phone-9B (opens new window) 模型,可以自己在 GPU 部署。

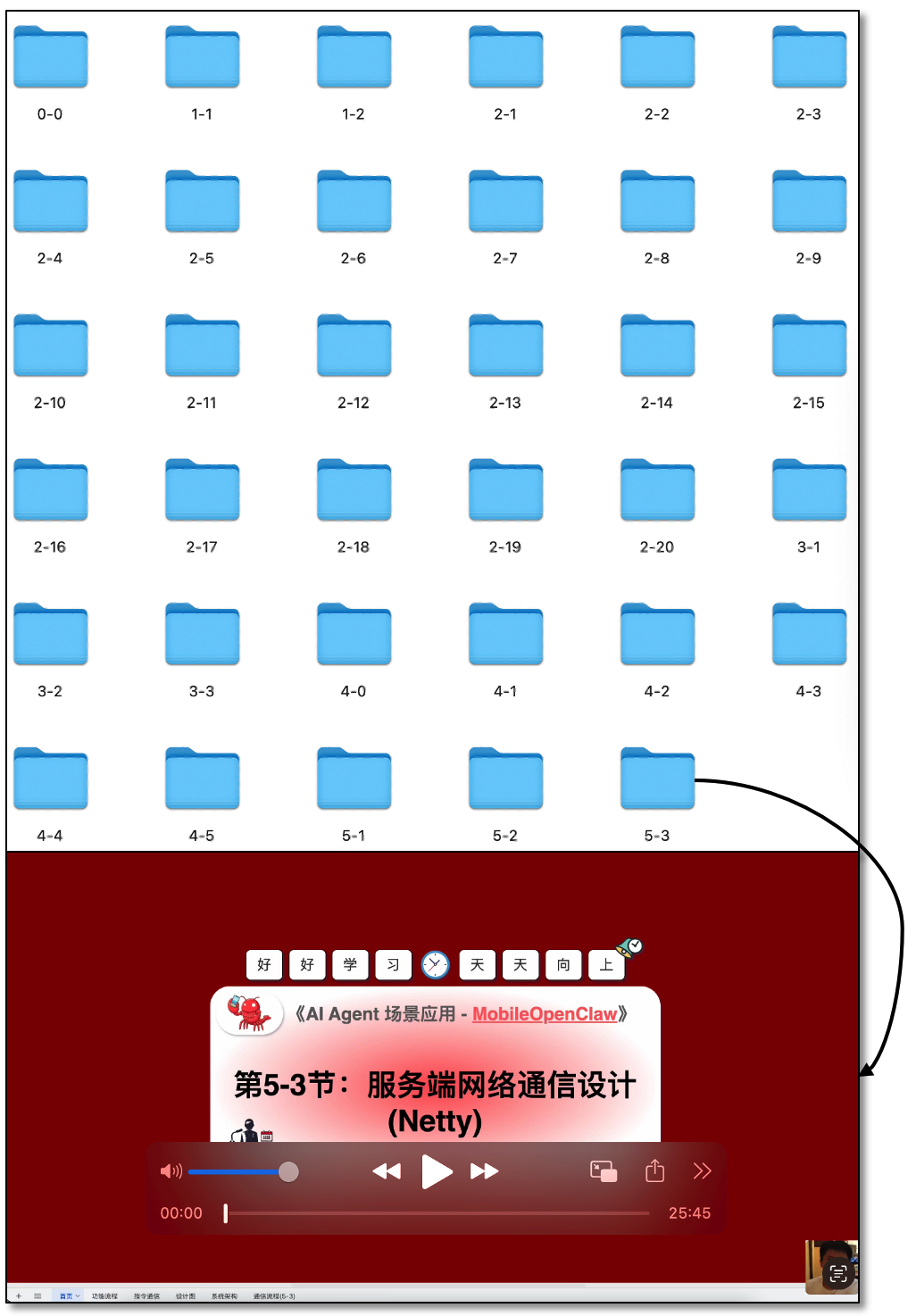

# 五、课程学习目录

全程视频 + 文档 + 源码,开局 IntelliJ IDEA + Webstorm + Android Studio,手把手带着你一路狂飙!

以下2、3、4部分,每部分做完,都可以写简历,也就是最早学习完2部分20节,就可以写一份简历啦!

# 介绍

AI Agent 脚手架 + 场景应用 - 综合 Spring AI、LangChain4j + Google ADK(a2a、mcp、skills),打造全新智能体架构方案。

# 第1部分:需求与架构

# 第2部分:基础底座开发

- 第2-1节:工程初始化创建

- 第2-2节:Api功能测试

- 第2-3节:智能体配置表设计

- 第2-4节:装配域结构化定义

- 第2-5节:装配域节点-AiApiNode

- 第2-6节:装配域节点-ChatModelNode

- 第2-7节:装配域节点-AgentNode

- 第2-8节:装配域节点-AgentWorkflowNode

- 第2-9节:装配域节点-Loop、Parallel、Sequential

- 第2-10节:装配域节点-RunnerNode

- 第2-11节:智能体加载使用验证

- 第2-12节:增强装配-RunnerNode

- 第2-13节:增强装配-AgentWorkflowNode

- 第2-14节:增强装配-本地mcp

- 第2-15节:增强装配-回调plugin

- 第2-16节:fix-多模态能力使用

- 第2-17节:会话服务接口实现-service

- 第2-18节:会话服务接口实现-trigger

- 第2-19节:会话服务接口对接-ui

- 第2-20节:增强装配-skills

# 第3部分:脚手架工程化

# 第4部分:业务场景(ai+draw.io) - 这部分内容非常有实用价值!

- 第4-0节:ai + draw.io 产品设计

- 第4-1节:初始化工程搭建

- 第4-2节:在页面嵌入draw.io组件和对话框

- 第4-3节:智能体API接口对接

- 第4-4节:AI+用户+DrawIO,交互式画图

- 第4-5节:ai-draw-io,云服务器部署

# 第5部分:业务场景(MobileOpenClaw)- 这部分内容非常有意思!

- 第5-0节:MobileOpenClaw 产品设计

- 第5-1节:初始化工程搭建

- 第5-2节:手机网关能力设计

- 第5-3节:通过 Netty 进行同步等待通信

- 第5-4节:智能体初步配置使用

- 第5-5节:智能体工作流设计

- 第5-6节:异步结果响应

- 第5-7节:图片位点识别增强

- 第5-8节:多版本安卓版本策略支持

- 第5-9节:会话上下文细化处理

星球里另外一套 AI Agent 还对接了 ELK、普罗米修斯、微信公众号等,也可以把 MCP 对接过来进行系统巡检。有了这套脚手架的学习,你可以完成非常多的场景对接使用。

# 六、学习路线推荐(AI)

小傅哥的社群星球「码农会锁」,现已经有20个实战项目,6个AI、5个业务、8个组件 + 1套源码(MyBatis),这6个AI项目,你可以按需选择学习。

综上,所有的实战项目,加入小傅哥社群,全部都可以学习的到!